AI saknar förnuft – därför kan programmen inte tänka

"Kan AI tänka?" Det är titeln på kognitionsforskaren Peter Gärdenfors nya bok, och det korta svaret är: nej, åtminstone inte så som människor tänker. AI saknar motivation, avsikter och empati. Till och med tvååringar har något som våra artificiella system saknar – förmågan att tänka i termer av orsak och verkan.

Sedan ChatGPT introducerades med buller och bång 2022 har debatten om AI som ett framtida hot intensifierats. Forskare som Nick Bostrom, Max Tegmark och Olle Häggström hävdar att det är möjligt, och kanske till och med sannolikt, att AI-system i framtiden kommer att överträffa människor inom de flesta kognitiva områden – det som kallas artificiell generell intelligens – AGI. Medan AGI är en intelligens som skulle kunna hantera alla typer av kognitiva uppgifter är ”smal” AI, som finns idag, inriktad på specifika uppgifter som att spela schack eller analysera data.

Vad AI inte kan

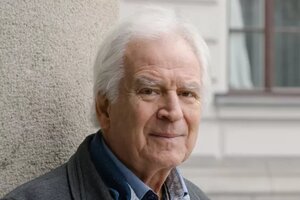

Peter Gärdenfors är professor i kognitionsvetenskap vid Lunds universitet och har intresserat sig för AI och tänkande i över femtio år. Han anser att den snabba utvecklingen har varit överraskande. Han ger exemplet att det inom medicin har utvecklats flera program som kan leda till stora genombrott.

AGI finns dock inte idag och ingen vet hur det ska skapas. De AI-system som existerar idag, även de mest avancerade, är mycket specialiserade och saknar den breda och flexibla intelligens som människor har. De är också helt beroende av oss. Om vi skulle stänga av ett AI-system eller vägra samarbeta med det, skulle AI inte kunna fungera självständigt.

– En tvååring kan mycket som inte ett artificiellt system kan. Till exempel orsakstänkande – att förstå att den här handlingen får den konsekvensen. Detta lär sig små barn redan på förskolan. Vad händer när du biter din kompis, eller om du säger si eller så. En tvååring har därför bättre orsakstänkande, säger Peter Gärdenfors.

Småbarn lär sig mycket under första åren genom att ramla, bygga klossar och kasta saker. Detta kallas för ”förkroppsligat tänkande”. En tvååring kan förstå varför någon vinkar eller varför någon viftar bort en fluga, medan AI bara ”ser” två olika handrörelser. AI har ingen förmåga att tolka sociala signaler eller förstå intentioner. Därför är ironi särskilt svårt för AI-system.

AI saknar också kreativitet, känslor och anpassningsförmåga, även om programmen kan simulera detta. En tvååring kan snabbt lära sig nya saker och anpassa sig till nya miljöer genom lek och erfarenheter, medan AI är begränsat till den data det har tränats på.

Även om AI-system utmärkt sig vad gäller att exempelvis granska mammografibilder på ett exakt sätt, så saknar de omdöme. Därför krävs mänsklig övervakning så att de inte hamnar snett i udda situationer som de inte tränats på, menar Peter Gärdenfors. Det kan till exempel handla om granskning av ovanliga bilder som avviker från tidigare mönster.

När man lyfter fram ett AI-systems eller en robots framgångar är det lätt att fokusera på de problem som systemet lyckas lösa och kanske bli imponerad av detta, och glömma allt det de inte kan, menar Peter Gärdenfors:

– Rutinsituationer klarar artificiella system mycket bättre än vad vi gör. Men systemen har svårare att hantera nya problem. En pilot som hamnar i en ny situation kan många gånger lösa den baserat på omdöme och tidigare erfarenheter.

Vadå intelligens

Det är kanske missvisande att använda begreppet ”intelligens”, oavsett om man talar om människor, djur eller system.

– Intelligensbegreppet är fånigt och begränsade. Jag föredrar begreppet förnuft. Folk tror att man mäter intelligens med intelligenstest. Men IQ-test är väldigt snäva och mäter inte hur du agerar i världen. De är också väldigt utbildningsberoende: är du högt utbildad höjer du din IQ, säger Peter Gärdenfors.

Kvinnor presterade bättre än män på de första IQ-testen. Därför höjde man matematikdelen och sänkte språkdelen, eftersom kvinnor generellt är starkare på språk och män på matematik. Hela poängen var nämligen att testet skulle visa att män och kvinnor i snitt är lika intelligenta. När det kommer till IQ-test är det heller inte några problem för ett AI-system att få högsta pott – förutsatt att man låter den öva på liknande material.

Överdrivna risker

Riskerna med AI handlar därför inte så mycket om att systemen blir för intelligenta, utan om att människor använder dem på fel sätt, menar Peter Gärdenfors:

– Om AI används oansvarigt eller för destruktiva syften kan det bli farligt, men till slut är det människor som styr hur systemen brukas.

Att systemen tränar på data som kan vara rasistiska eller sexistiska – eftersom sådana snedvridningar finns i bakgrundsmaterialet – är ett problem, som idag hanteras genom manuell granskning. Mänskligt förnuft måste alltså kopplas in för att korrigera det AI lärt sig. Ett annat exempel är desinformation. Men ”fake news” finns oberoende av artificiell intelligens, menar Peter Gärdenfors, och systemen som redan idag påverkar våra beslut och uppmärksamhet är relativt enkla.

– Risken är inte att AI och robotar blir för intelligenta, utan att vi människor är för dumma. Vi är redan överkörda av många av de här systemen när vi låter dem välja åt oss. Det krävs inga avancerade system för att Youtube ska välja vilken video vi ska se utifrån våra visade intressen, och göra ett urval som blir mer och mer spektakulärt, säger Peter Gärdenfors.

Ett annat problem som lyfts fram i debatten är att AI kommer göra många arbetslösa. Detta är i sig inget nytt när en ny teknik ändrar spelplanen.

– Gaslyktetändare blev arbetslösa när elektriciteten kom. Men det finns fler elektriker idag än det finns gaslyktetändare. All ny teknik tar bort jobb men skapar också nya jobb, säger Peter Gärdenfors.

Men varför känner då människan sympati för fyrfota robotar, ger namn åt sin gräsklippare och blir kompis med ChatGPT? Och varför säger vi att en dator tänker när den dröjer med att ge ett svar?

Vi människor läser gärna in väldigt mycket mer i våra maskiner och husdjurs beteende än vad som verkligen finns där. Men en dator kan inte tänka, den har – till skillnad från djur – inget medvetande eller intention. Chattsystemen förstår inte vad de skriver, de är ingen kompis, utan de simulerar bara hur människor producerar språk.

– Vi läser in för mycket i våra husdjur och alldeles för mycket i robotar. Alla husdjursägare överdriver sina djurs förmågor. Vi har en liknande syn på ChatGPT. Vi behandlar programmet som att det är en människa vi chattar med. Det är vårt eget fel. Där är för att vi är okritiska, säger Peter Gärdenfors.

Här är djur bättre än AI

Baserat på forskning visar Peter Gärdenfors i boken ”Kan AI tänka” varför AI sannolikt aldrig kommer tänka på samma sätt som vi människor och djur gör. Ursprungligen skulle också boken heta ”Hur människor, djur och robotar tänker”. På Lunds universitets avdelning för kognitionsvetenskap vid Filosofiska institutionen pågår forskning om såväl djurs som robotars kognitiva förmågor. I boken lyfts också flera exempel fram där djur har högre kapacitet än AI-system.

Smarta kråkor

Kråkor är kända för att kunna tillverka och använda enkla verktyg, som att böja ståltråd för att nå föda. Detta visar deras avancerade problemlösningsförmåga och förståelse för orsak och verkan. De kan även planera för framtiden genom att gömma mat och minnas var de gömt den flera månader senare. AI kan inte tillverka verktyg eller planera på samma sätt som kråkor, eftersom AI saknar förståelse för orsak och verkan i den fysiska världen.

Skamsna hundar

Hundars skamsna uttryck, som ofta tolkas som skuld, är egentligen en reaktion på människors kroppsspråk och känslor. Hundar försöker undvika konflikt genom att visa undergivenhet, men de förstår inte konceptet skuld. AI kan inte undvika konflikt genom sociala signaler som undergivenhet, eftersom AI saknar förmåga att tolka och agera utifrån sociala sammanhang och känslor.

Empatiska, lekfulla råttor

Råttor ger ifrån sig högfrekventa ljud som liknar skratt när de blir kittlade eller leker, något som forskare har tolkat som ett tecken på glädje. Forskning visar också att råttor har förmåga till empati. I experiment där en råtta får en belöning genom att trycka på en spak, men samtidigt ger en annan råtta en elektrisk stöt, väljer råttan att sluta trycka på spaken trots att den går miste om sin belöning. AI kan inte känna empati eller skratta, även om systemen kan simulera dessa uttryck.

Kontakt

Peter Gärdenfors

Professor i Kognitionsvetenskap

peter.gardenforslucs.luse